워싱턴포스트가 제시한 조작동영상 유형 및 분류 기준

거짓 동영상이 인터넷에 넘쳐난다. 정치인, 이익 집단 그리고 일반 네티즌들의 손을 거쳐 수백만 명에게 퍼져 나간다. 조작된 동영상을 구분하고 잘못된 정보 전달을 막기 위해 워싱턴포스트의 팩트체크 전담팀 <팩트체커>에서 전세계적으로 통용될 수 있는 분류 기준을 만들었다.

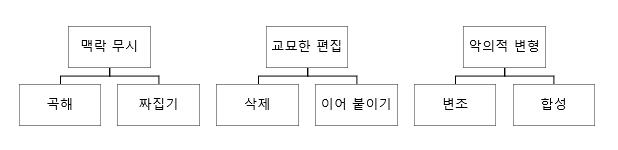

팩트체커는 조작 동영상을 크게 세 가지 종류로 구분한다. 자료의 앞뒤 맥락을 무시하거나, 영상을 교묘하게 편집하거나 혹은 고의적으로 변형시키거나. 상세한 분류는 아래의 도식을 따른다.

① 곡해 (Misrepresentation): 동영상을 원본 그대로 옮기지만 사실과 다른 설명이나 해석을 곁들이는 경우. 동영상의 본질을 왜곡하여 시청자를 오도한다. 원본 영상이 촬영된 날짜나 장소를 잘못 전달하는 것 등이 대표적인 예라고 할 수 있다.

사례 1) 도널드 트럼프 대통령과 맷 게이츠 플로리다주 하원의원 (공화당)은 2018년 중간선거를 앞두고 트윗을 통해 출처 불명의 영상을 공유했다. 두 사람의 주장에 따르면 영상은 온두라스에서 촬영되었고 몇몇 남성이 여성과 아이들에게 미국에 밀입국하는 데 필요한 돈을 전달하는 장면을 보여주고 있다. 하지만 해당 영상은 온두라스가 아닌 과테말라에서 촬영된 것으로 드러났으며, 남자들이 사람들에게 돈을 전달한 이유는 밝혀진 바 없다.

사례 2) 지난 5월 5일 트럼프 선관위 상임고문인 카트리나 피어슨은 가자지구에서 이스라엘을 향해 발사된 로켓이라며 트위터에 영상을 올렸다. 알고 보니 2014년경 벨라루스에서 촬영된 것이었다.

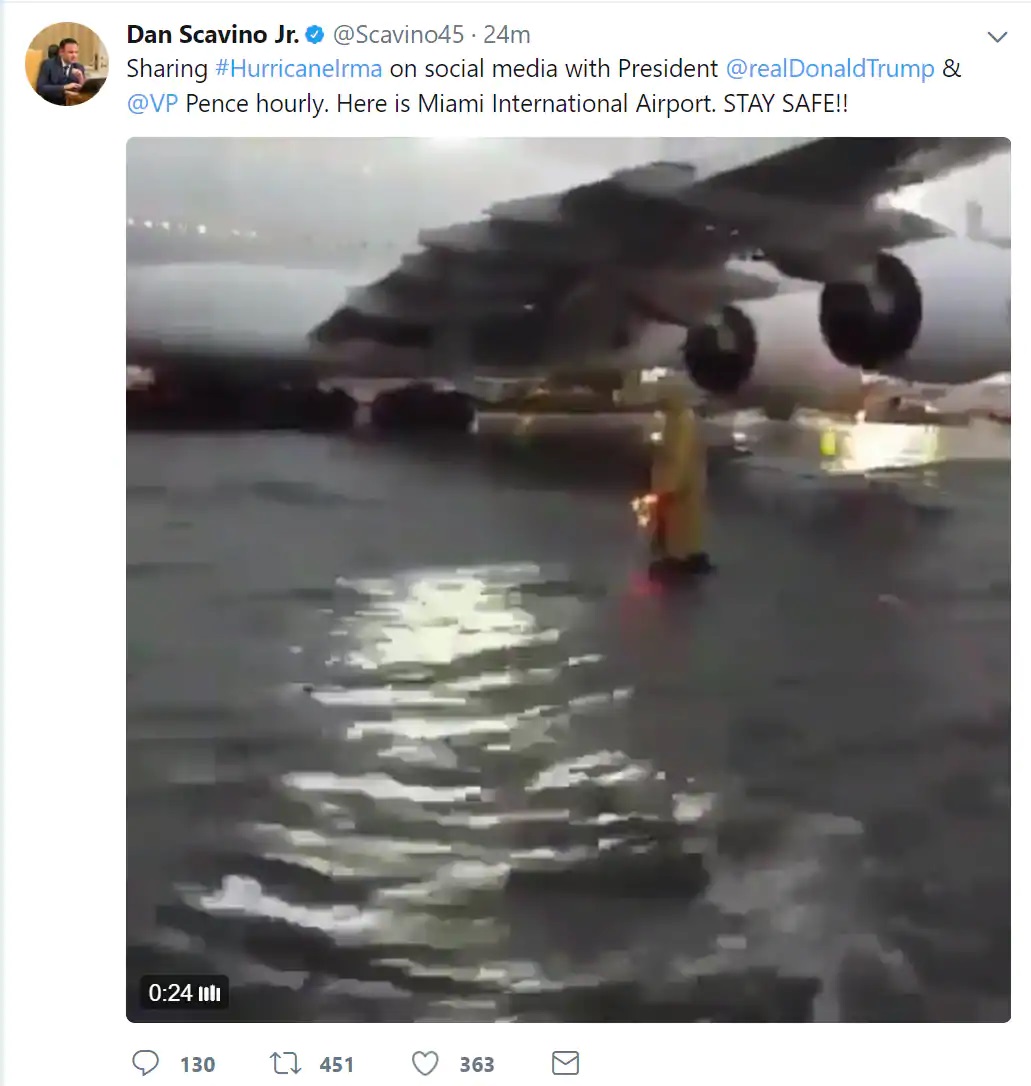

사례 3) 백악관 소셜미디어 공보담당 댄 스카비노는 트윗을 통해 태풍 어마 (Irma)에 의해 침수된 마이애미 국제공항의 영상을 공유했다. 수분 내로 마이애미 공항 측에서 반박 트윗을 올려 해당 영상은 자신들과 관계가 없다고 밝혔다. 나중에 밝혀진 바로는 수 주 전 멕시코 시티에서 촬영된 영상이었다. 스카비노는 추후 실수를 인정하고 트윗을 삭제했다.

② 짜집기 (Isolation): 영상의 일부만을 떼어와 게시하는 경우에 해당한다. 영상 전체 맥락을 반영하지 않은 거짓 내러티브를 생산한다. 한쪽의 편향된 주장만을 담은 1인칭 시점 비디오도 여기에 포함된다 볼 수 있다.

사례 1) 미국-이슬람 관계 협회 (Council on American-Islamic Relations; CAIR) 주최 만찬 도중 열린 연설에서 일한 오마르 미네소타주 하원의원 (민주당)은 “CAIR는 9/11 테러 이후 설립되었는데 이는 일부 사람들로 인해 우리 [무슬림]의 자유가 훼손되기 시작했음을 인식했기 때문”이라고 (“CAIR was founded after 9/11 because they recognized that some people did something and that all of us were starting to lose access to our civil liberties”) 주장했다. 해당 발언은 앞뒤 맥락을 제외한 채로 ‘짜집기’되어 SNS에서 공유되었고 많은 논란을 낳았다.

사례 2) 카말라 해리스 캘리포니아주 상원의원 (민주당)은 트위터에 브랫 캐버노 대법관 후보자의 청문회 답변 영상을 업로드하며 캐버노 후보자가 피임 규제를 암시하는 발언을 했다는 주장을 폈다. 하지만 해당 비디오에서 캐버노가 관련 재판 원고 측의 주장을 인용한 것인지 아니면 자신의 의견을 표명한 것인지는 분명치 않다. 다음날 해리스는 후속 트윗에 발언 전문이 담긴 영상을 업로드했다.

사례 3) 2012년 당시 공화당 대통령 후보였던 미트 롬니 전 상원의원은 아이오와 주에서 열린 간담회에서 사회보장 정책을 논하던 중 “대기업” (“corporations”)을 외치며 난입한 반대자들의 방해를 받았다. 여기에 롬니 후보가 “대기업도 국민”이라고 답한 것이 논란을 일으켰다. 이후 해당 발언은 소셜 미디어에서 앞뒤 맥락 없이 인용돼 롬니의 친기업적인 면모를 보여주는 예로서 확대 재생산되었다.

① 삭제 (Omission): 영상의 많은 부분을 삭제한 뒤 마치 원본 전체인 것처럼 소개하는 것을 의미한다.

사례 1) 어린 아이들이 다이앤 파인스타인 캘리포니아주 상원의원 (민주당)을 만나 그린 뉴딜 정책에 대한 지지를 호소하는 내용이 동영상에 담겼다. 환경운동 단체 Sunrise Movement는 당시 만남의 일부분을 SNS에 올렸다. 영상에서 보여지는 것처럼 대화 초반에 열띤 토론이 벌어진 것은 사실이나 원본을 보면 만남이 전반적으로 차분한 분위기 속에서 진행되었음을 확인할 수 있다.

사례 2) 미국의 매체 Live Action이 성교육과 산모 복지 등을 담당하는 단체인 가족계획연맹 (Planned Parenthood) 직원을 인터뷰한 영상의 일부를 공개했다. 영상 대부분을 잘라내 해당 직원이 낙태를 권장하는 것처럼 들리게끔 편집한 것으로 드러났다.

사례 3) 공화당 소속 상원의원들과 어떻게 협력할 것이냐는 질문에 조 바이든 민주당 대선 예비후보가 “물리적인 혁명” (“physical revolution”)을 일으키겠다고 대답한 영상 발췌본이 논란이 되었다. 마찬가지로 앞뒤 맥락 없이 인용하여 본래 의미를 왜곡한 것이다.

Democratic presidential candidate Joe Biden says that the way he would deal with Senate Republicans who oppose his agenda is with a “brass knuckle fight,” later adds: “Let’s start a real physical revolution if you’re talking about it” pic.twitter.com/GQPmDGxJpo

— Ryan Saavedra (@RealSaavedra) 2019년 6월 18일

② 이어 붙이기 (Splicing): 각기 다른 두 개 이상의 비디오 일부분을 잘라내어 합치는 경우를 말한다.

사례 1) 미국의 보수성향 미디어 CRTV는 알렉산드리아 오카시오-코르테즈 뉴욕주 하원의원 (민주당)의 발언 일부를 추출한 뒤 자사 앵커의 질문에 대한 답변인 것처럼 영상을 이어 붙였다. 해당 영상은 업로드된지 24시간도 되지 않아 조회수 100만을 기록했다. 이후 CRTV는 영상이 풍자였다고 해명했으나 이미 논란이 불거진 뒤였다.

사례 2) 2012년 자신의 선거 홍보 영화(아래 동영상 'The Road We've Traveled')에 출연한 버락 오바마 전 대통령은 어머니가 과거 암에 걸리고도 보험금을 받지 못해 고생했던 이야기를 회고했다. 영화는 관련자들의 증언을 전하며 이야기를 뒷받침했다. 결과적으로 인터뷰 여러 개를 이어 붙인 허위 자료임이 밝혀졌다.

사례 3) 2016년 미국 대선 당시 송출된 힐러리 클린턴 후보 지지 광고가 문제가 됐다. 해당 광고는 별개의 맥락에서 이루어진 트럼프 당시 공화당 대선후보의 발언을 편집한 뒤 연결해 붙였다. 그 결과 트럼프가 핵전쟁을 옹호하는 것처럼 비춰질 수 있는 영상이 만들어졌고 그대로 전파를 탔다.

① 변조 (Doctoring): 비디오의 속도를 조절하거나, 화면 일부분을 잘라내거나, 음성을 덧입히거나 시각 정보를 추가 또는 삭제하는 등 영상의 프레임에 손을 대는 경우가 여기에 해당된다.

사례 1) 최근 낸시 팰로시 하원의장 (민주당)의 발언이 담긴 동영상이 SNS에서 화제가 되었는데, 술에 취해 어눌한 말투인 것처럼 악의적으로 변조된 영상이었다. 조회수는 수백만에 달했다. 영상을 공유한 사람 가운데는 트럼프 대통령도 포함돼 있었다. 특정 정치인의 평판을 훼손하기 위한 정치적인 의도를 갖고 유포한 것이다.

사례 2) 백악관은 CNN의 짐 아코스타 백악관 출입기자가 브리핑 도중 백악관 소속 인턴과 몸싸움을 벌이는 영상을 공유했다. 원본과 비교해 보면 몸싸움이 더 격렬하게 보이게끔 반복적으로 프레임을 늘렸음을 확인할 수 있다.

사례 3) 2018년 벌어진 파크랜드 고등학교 총격사건의 생존자이자 총기규제 운동가인 엠마 곤잘레즈가 미국 헌법이 적힌 종이를 찢는 gif파일이 SNS에 퍼졌다. 잡지 Teen Vogue에 게시된 원본은 사격 과녁을 찢는 내용이지만 누군가가 포토샵을 사용해 영상을 조작한 것이다.

② 합성 (Fabrication): 최신 인공지능 기술을 이용해 특정 인물의 얼굴이나 신체부위를 다른 영상 속 인물의 것과 정교하게 합성하는 기법을 의미한다. 딥페이크를 비롯한 영상편집물이 대표적인 예라고 할 수 있다.

사례 1) 마크 저커버그 페이스북 CEO가 스스로를 “도난당한 수십억 인구의 개인정보를 좌지우지하는 사람”이라고 (“one man, with total control over billions of people’s stolen data”) 소개한 영상. 저커버그의 얼굴 사진을 영상에 합성한 뒤 대역배우의 음성과 싱크가 맞게끔 조정했다.

사례 2) AI 프로그램을 이용해 트럼프 대통령의 연두교서 영상에 배우 니콜라스 케이지의 얼굴을 입혔다.

사례 3) 코미디언이자 영화감독인 조던 필의 성대모사 음성을 추출, 오바마 전 대통령의 영상에 합성했다. 해당 영상을 보면 AI기술이 오바마의 입모양까지 소리에 맞게 완벽히 구현했음을 확인할 수 있다.